学spark需要什么基础先学什么

发布时间:2025-05-19 16:05:05 发布人:远客网络

一、学spark需要什么基础先学什么

1,Spark框架是采用Scala语言编写的,精致而优雅。要想成为Spark高手,你就必须阅读Spark的源代码,就必须掌握Scala,;

2,虽然说现在的Spark可以采用多语言Java、Python等进行应用程序开发,但是最快速的和支持最好的开发API依然并将永远是Scala方式的API,所以你必须掌握Scala来编写复杂的和高性能的Spark分布式程序;

3,尤其要熟练掌握Scala的trait、apply、函数式编程、泛型、逆变与协变等;

第二阶段:精通Spark平台本身提供给开发者API

1,掌握Spark中面向RDD的开发模式,掌握各种transformation和action函数的使用;

2,掌握Spark中的宽依赖和窄依赖以及lineage机制;

3,掌握RDD的计算流程,例如Stage的划分、Spark应用程序提交给集群的基本过程和Worker节点基础的工作原理等

此阶段主要是通过Spark框架的源码研读来深入Spark内核部分:

1,通过源码掌握Spark的任务提交过程;

2,通过源码掌握Spark集群的任务调度;

3,尤其要精通DAGScheduler、TaskScheduler和Worker节点内部的工作的每一步的细节;

第四阶级:掌握基于Spark上的核心框架的使用

Spark作为云计算大数据时代的集大成者,在实时流处理、图技术、机器学习、NoSQL查询等方面具有显著的优势,我们使用Spark的时候大部分时间都是在使用其上的框架例如Shark、Spark Streaming等:

1, Spark Streaming是非常出色的实时流处理框架,要掌握其DStream、transformation和checkpoint等;

2, Spark的离线统计分析功能,Spark 1.0.0版本在Shark的基础上推出了Spark SQL,离线统计分析的功能的效率有显著的提升,需要重点掌握;

3,对于Spark的机器学习和GraphX等要掌握其原理和用法;

第五阶级:做商业级别的Spark项目

通过一个完整的具有代表性的Spark项目来贯穿Spark的方方面面,包括项目的架构设计、用到的技术的剖析、开发实现、运维等,完整掌握其中的每一个阶段和细节,这样就可以让您以后可以从容面对绝大多数Spark项目。

1,彻底掌握Spark框架源码的每一个细节;

2,根据不同的业务场景的需要提供Spark在不同场景的下的解决方案;

3,根据实际需要,在Spark框架基础上进行二次开发,打造自己的Spark框架;

二、有什么关于 Spark 的书推荐

1、《大数据Spark企业级实战》本书共包括14章,每章的主要内容如下。

2、第一章回答了为什么大型数据处理平台都要选择SPARK。为什么spark如此之快?星火的理论基础是什么?spark如何使用专门的技术堆栈来解决大规模数据处理的需要?

第二章回答了如何从头构建Hadoop集群的问题。如何构建基于Hadoop集群的星火集群?如何测试火星的质量?

3、第二章回答了如何从头构建Hadoop集群的问题。如何构建基于Hadoop集群的星火集群?如何测试火星的质量?

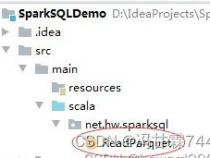

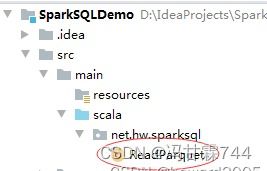

4、第三章是如何在一个集成开发环境中开发和运行星火计划。如何开发和测试IDA中的spark代码?

5、在这4章中,RDD、RDD和spark集成战斗用例API的作用类型将用于实际的战斗RDD。

6、第四章分析了星火独立模式的设计与实现、星火集群模型和星火客户端模式。

7、第五章首先介绍了spark core,然后通过对源代码的分析,分析了spark的源代码和源代码,仔细分析了spark工作的整个生命周期,最后分享了spark性能优化的内容。

8、这说明了一步一步的火花的特点是使用了大约30个实际案例,并分析了spark GraphX的源代码。

9、第八章,在星火SQL实践编程实践的基础上,详细介绍了星火SQL的内容。

10、第九章讲了从快速启动机器学习前9章,MLlib的分析框架,基于线性回归、聚类,并解决协同过滤算法,源代码分析和案例启示MLlib一步一步,最后由基本MLlib意味着静态和朴素贝叶斯算法,决策树分析和实践,进一步提高的主要引发机器学习技巧。

11、第十章详细描述了分布式存储文件系统、超轻粒子和超轻粒子的设计、实现、部署和使用。

12、第十一章主要介绍了火花流的原理、源代码和实际情况。

13、第十二章介绍了spark多语种编程的特点,并通过实例介绍了spark多语言编程。最后,将一个综合的例子应用到spark多语言编程的实践中。

14、第十三章首先介绍了R语言的基本介绍和实践操作,介绍了使用sparkr和编码的火花,并帮助您快速使用R语言和数据处理能力。

15、在第十四章中,详细介绍了电火花放电的常见问题及其调谐方法。首先介绍了14个问题,并对它们的解决方案进行了优化。然后,从内存优化、RDD分区、对象和操作性能优化等方面对常见性能优化问题进行了阐述,最后阐述了火花的最佳实践。

16、附录从spark的角度解释了Scala,并详细解释了Scala函数编程和面向对象编程。

三、如何学习Spark API

Spark采用一个统一的技术堆栈解决了云计算大数据的如流处理、图技术、机器学习、NoSQL查询等方面的所有核心问题,具有完善的生态系统,这直接奠定了其一统云计算大数据领域的霸主地位;

要想成为Spark高手,需要经历一下阶段:

1, Spark框架是采用Scala语言编写的,精致而优雅。要想成为Spark高手,你就必须阅读Spark的源代码,就必须掌握Scala,;

2,虽然说现在的Spark可以采用多语言Java、Python等进行应用程序开发,但是最快速的和支持最好的开发API依然并将永远是Scala方式的API,所以你必须掌握Scala来编写复杂的和高性能的Spark分布式程序;

3,尤其要熟练掌握Scala的trait、apply、函数式编程、泛型、逆变与协变等;

第二阶段:精通Spark平台本身提供给开发者API

1,掌握Spark中面向RDD的开发模式,掌握各种transformation和action函数的使用;

2,掌握Spark中的宽依赖和窄依赖以及lineage机制;

3,掌握RDD的计算流程,例如Stage的划分、Spark应用程序提交给集群的基本过程和Worker节点基础的工作原理等

此阶段主要是通过Spark框架的源码研读来深入Spark内核部分:

1,通过源码掌握Spark的任务提交过程;

2,通过源码掌握Spark集群的任务调度;

3,尤其要精通DAGScheduler、TaskScheduler和Worker节点内部的工作的每一步的细节;

第四阶级:掌握基于Spark上的核心框架的使用

Spark作为云计算大数据时代的集大成者,在实时流处理、图技术、机器学习、NoSQL查询等方面具有显著的优势,我们使用Spark的时候大部分时间都是在使用其上的框架例如Shark、Spark Streaming等:

1, Spark Streaming是非常出色的实时流处理框架,要掌握其DStream、transformation和checkpoint等;

2, Spark的离线统计分析功能,Spark 1.0.0版本在Shark的基础上推出了Spark SQL,离线统计分析的功能的效率有显著的提升,需要重点掌握;

3,对于Spark的机器学习和GraphX等要掌握其原理和用法;

第五阶级:做商业级别的Spark项目

通过一个完整的具有代表性的Spark项目来贯穿Spark的方方面面,包括项目的架构设计、用到的技术的剖析、开发实现、运维等,完整掌握其中的每一个阶段和细节,这样就可以让您以后可以从容面对绝大多数Spark项目。

1,彻底掌握Spark框架源码的每一个细节;